פרק זה יציג את הממצאים העולים מניתוח תגובות הפלטפורמות לדיווחי קו הסיוע לאינטרנט בטוח של איגוד האינטרנט הישראלי שהועברו בחודשיים הראשונים למלחמת חרבות ברזל (07.12.23 – 07.10.23) ויתאר זאת לפי סוגי הפגיעות בפלטפורמות השונות, משך זמן התגובה וימי המענה ואופי והיקף הטיפול בדיווחים.

ג1. היקף וסוג הדיווחים שבהם טיפל קו הסיוע לאינטרנט בטוח

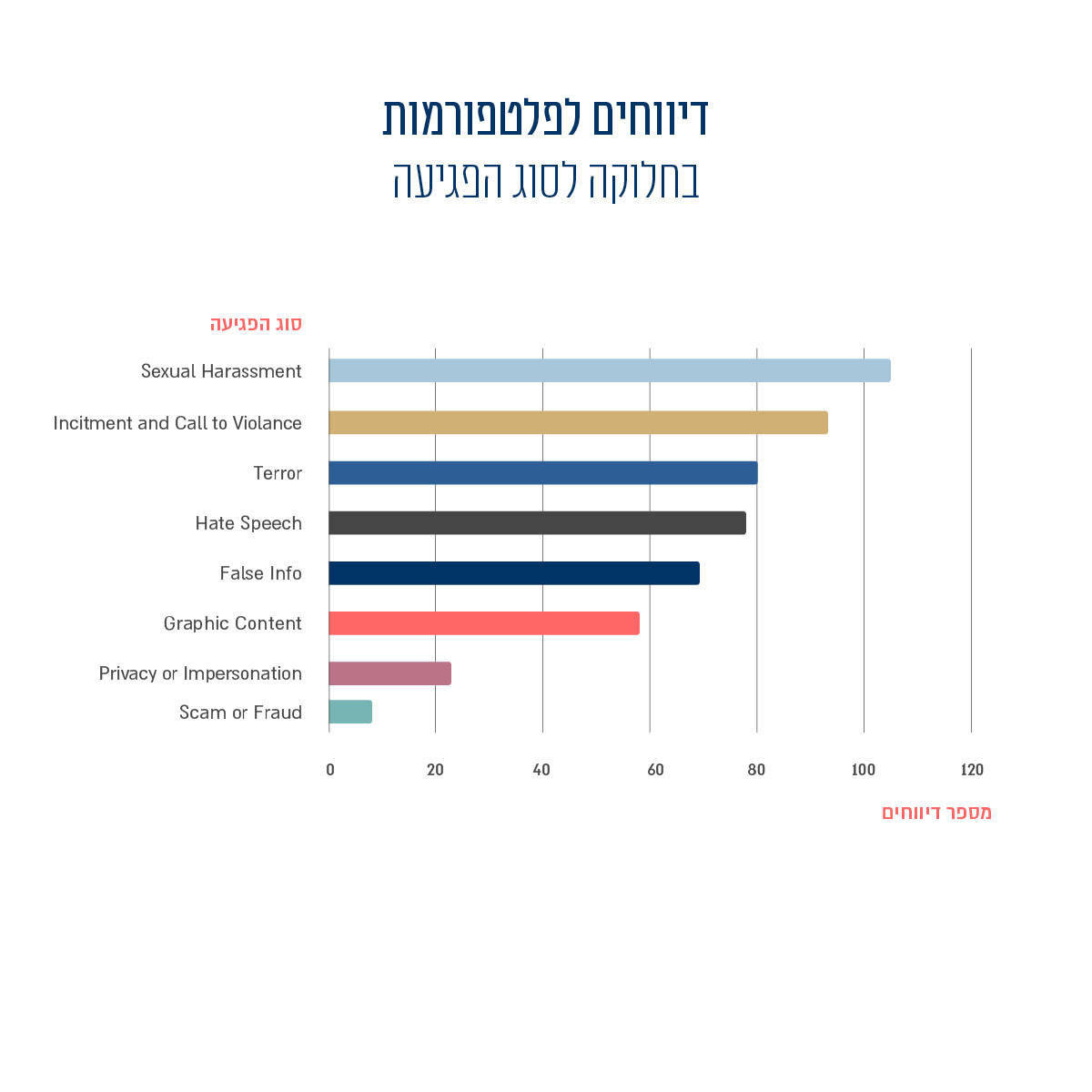

ראשית, הדיווחים שהעביר קו הסיוע לפלטפורמות מוינו לפי סוגי הפגיעה: פגיעות על רקע מיני (105), הסתה וקריאה לאלימות (93), תוכני טרור (80), שיח שטנה (78), מידע שגוי (69), תוכן גרפי (58), פגיעות בפרטיות והתחזות (23) והונאות ועוקצים (8).

דיווחים לפלטפורמות בחלוקה לסוג הפגיעה

דיווחים לפלטפורמות בחלוקה לסוג הפגיעה

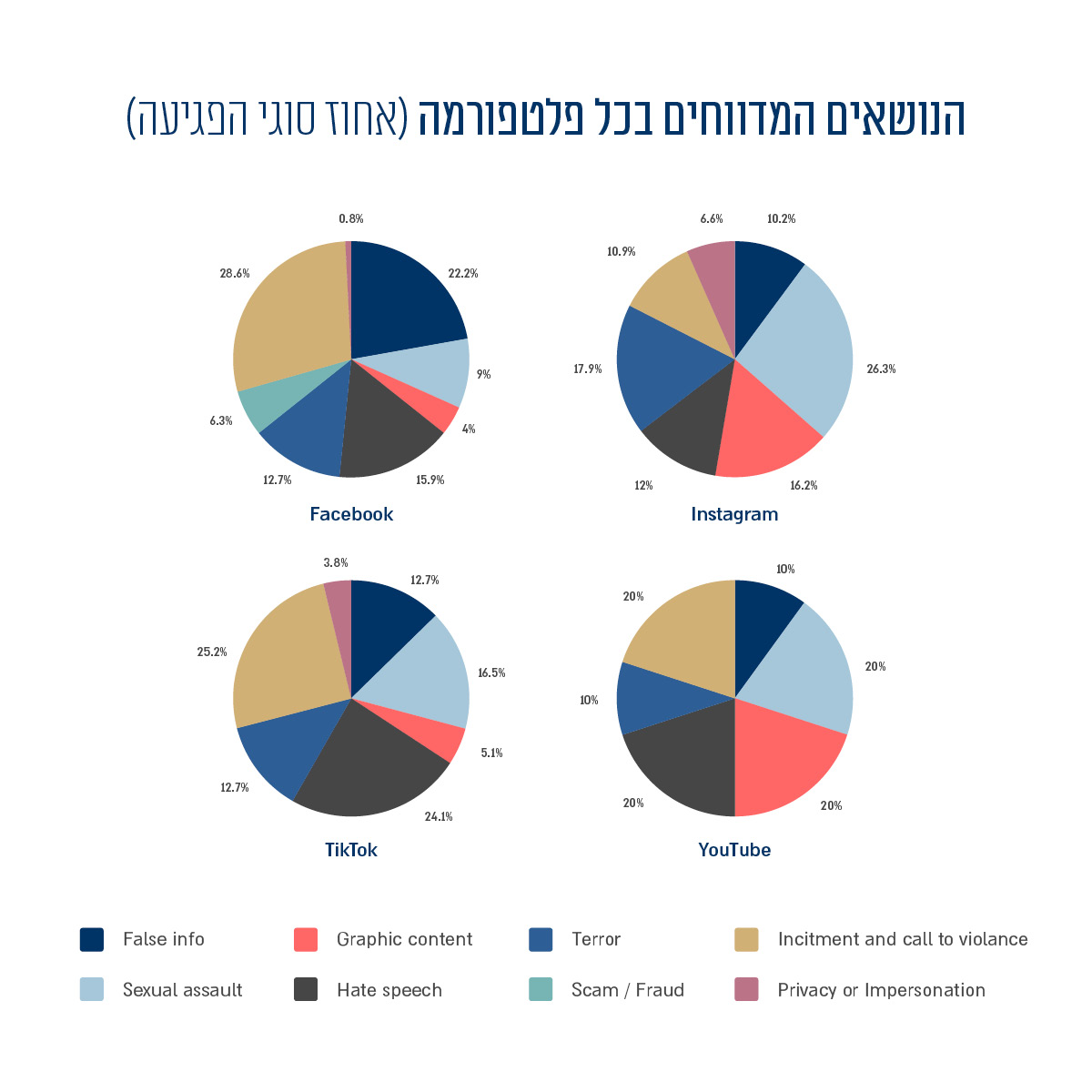

התרשים בעמוד הבא מצביע על שונות בין הנושאים המדווחים ביותר בפלטפורמות השונות, כאשר בפייסבוק נושאים אלה הם מידע שקרי והסתה וקריאה לאלימות; בטיקטוק – שיח שטנה והסתה וקריאה לאלימות; ובאינסטגרם הנושאים הבולטים הם פגיעות בעלות אופי מיני, תכנים גרפיים וטרור.

הנושאים המדווחים בכל פלטפורמה (אחוז סוגי הפגיעה)

הנושאים המדווחים בכל פלטפורמה (אחוז סוגי הפגיעה)

ג2. בחינת זמן התגובה לדיווחי קו הסיוע

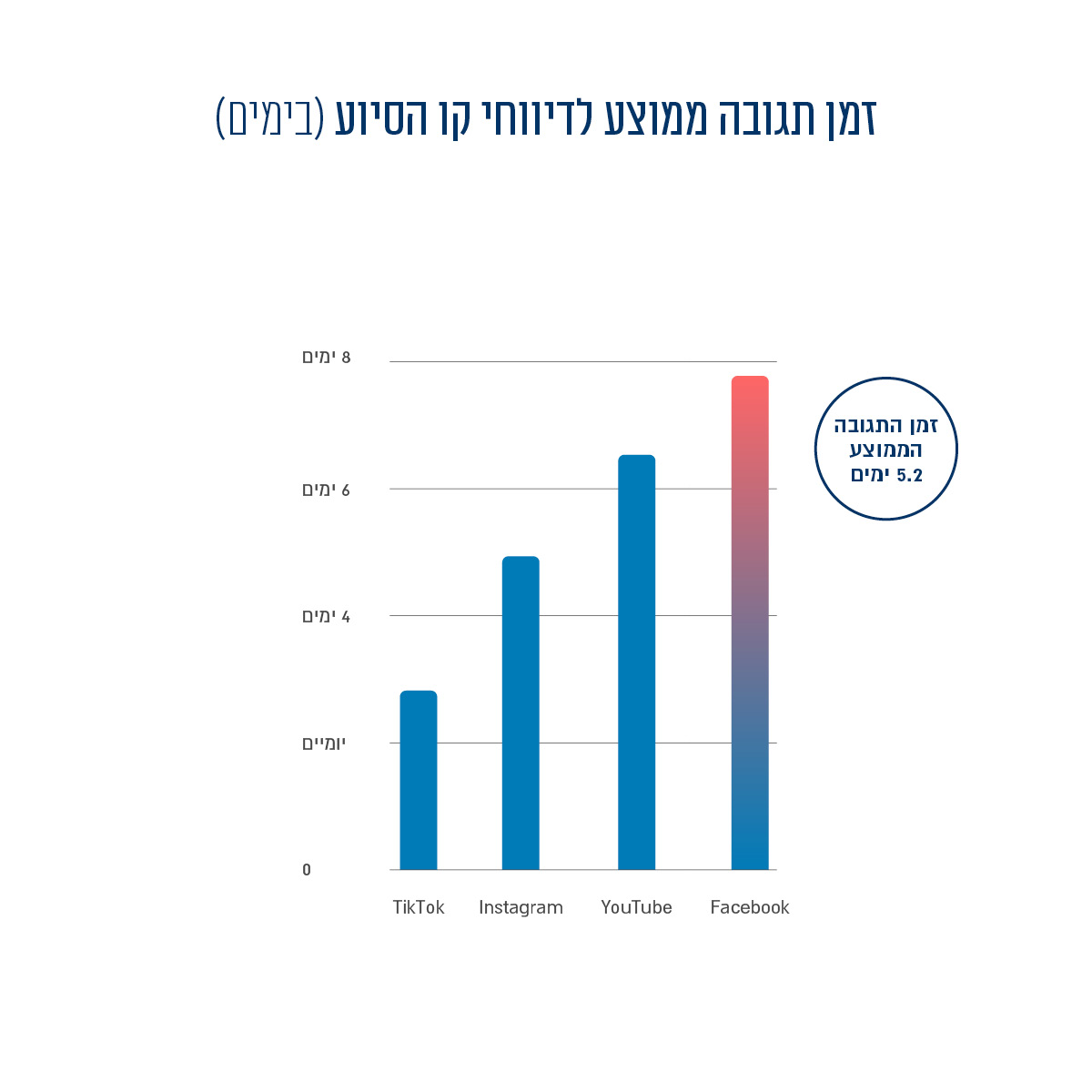

זמן תגובה ממוצע לדיווחי קו הסיוע (בימים)

זמן תגובה ממוצע לדיווחי קו הסיוע (בימים)

הזמן הממוצע לקבלת מענה מכלל הפלטפורמות לדיווחים ששלח קו הסיוע בחודשיים הראשונים למלחמה עמד על כ-5 ימים. חישוב הזמן הממוצע התבסס רק על דיווחים שזכו לתגובה עד לעת סגירת הנתונים לביצוע המחקר ב-11.01.24, ואינו כולל דיווחים שלא נענו כלל. לפיכך, נוסף על זמן המענה הממוצע יש להביא בחשבון את אחוז הדיווחים שלא קיבלו מענה בפלטפורמות השונות.

להלן אחוז הפניות של קו הסיוע שלא קיבלו מענה בפלטפורמות השונות עד למועד איסוף הנתונים למחקר זה – אמצע ינואר 2024 (למעלה מ-50 יום אחרי סוף התקופה הנבחנת): פייסבוק – 1 מתוך 103 (1%), אינסטגרם – 9 מתוך 253 (3.6%), טיקטוק – 6 מתוך 60 (10%), יוטיוב – התקבל מענה לכל הפניות, X – מענה אוטומטי – אין משמעות למדידת הזמן ולכן פלטפורמה זו הושמטה מהסעיף הנוכחי.

ניתן לראות כי ישנם הבדלים ניכרים בין הפלטפורמות השונות מבחינת זמני התגובה. בעוד טיקטוק הגיבה לדיווחי קו הסיוע בתוך שלושה ימים בממוצע, זמן התגובה הממוצע של פייסבוק היה למעלה משבוע. חשוב לציין כי נמצא גם הבדל בין זמני התגובה של פייסבוק ואינסטגרם. אף ששתי הפלטפורמות הן בבעלות חברת מטא, ולכאורה כפופות למדיניות תוכן זהה, זמן התגובה של פייסבוק לדיווחי קו הסיוע היה ארוך בממוצע בשלושה ימים כמעט – פער בולט עבור פלטפורמות שונות באותה בעלות.

זמני התגובה לדיווחי קו הסיוע בשבועות הראשונים למלחמה

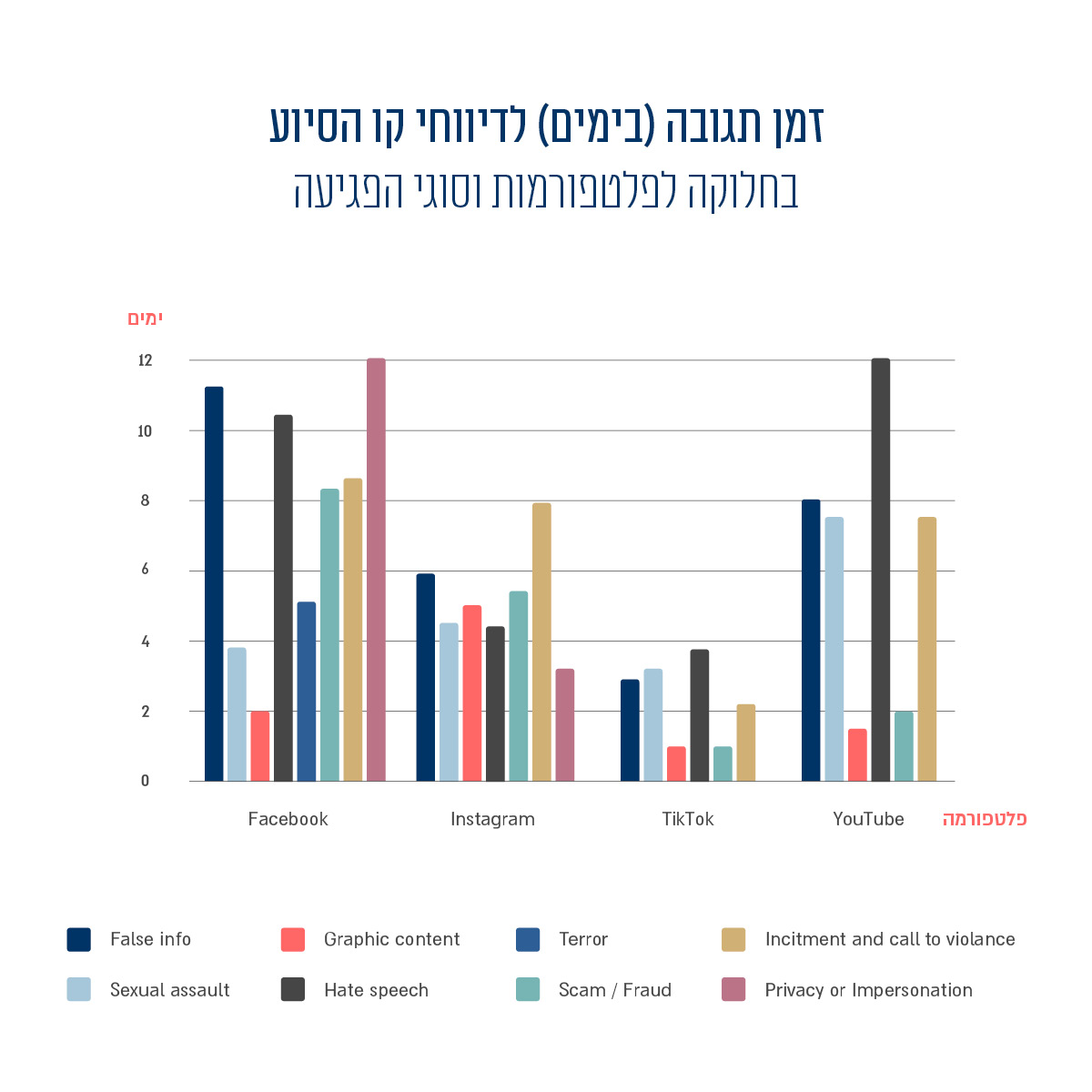

בשבוע הראשון למלחמה, פייסבוק, אינסטגרם וטיקטוק נענו לדיווחי קו הסיוע תוך כ-24-72 שעות. בעוד שטיקטוק המשיכה לתת מענה לדיווחי קו הסיוע בתוך 24-48 שעות בשלושת השבועות הראשונים של המלחמה, זמני התגובה הממוצעים של אינסטגרם ופייסבוק התארכו בשבוע השני של המלחמה לכ-7 ימים. בתרשים הבא מוצג זמן התגובה

של כל פלטפורמה בחלוקה לסוגי תוכן:

זמן תגובה (בימים) לדיווחי קו הסיוע בחלוקה לפלטפורמות וסוגי הפגיעה

זמן תגובה (בימים) לדיווחי קו הסיוע בחלוקה לפלטפורמות וסוגי הפגיעה

בפייסבוק דיווחים על מידע מטעה, שיח שטנה וסוגיות של התחזות ופרטיות קיבלו תגובה לאחר זמן ארוך במיוחד – למעלה מ-10 ימים בממוצע. באינסטגרם פניות בנושאי הסתה וקריאה לאלימות מטופלות לאט יחסית לשאר הנושאים, וזמן התגובה עומד על למעלה משבוע. ביוטיוב דיווחים בנושאי תוכן גרפי וטרור מקבלים מענה מהיר יחסית, תוך 48 שעות, אולם שאר הדיווחים מקבלים מענה לאחר למעלה משבוע. ואילו בטיקטוק זמני התגובה הממוצעים קצרים, ומתקרבים ברובם למסגרת של 72 שעות.

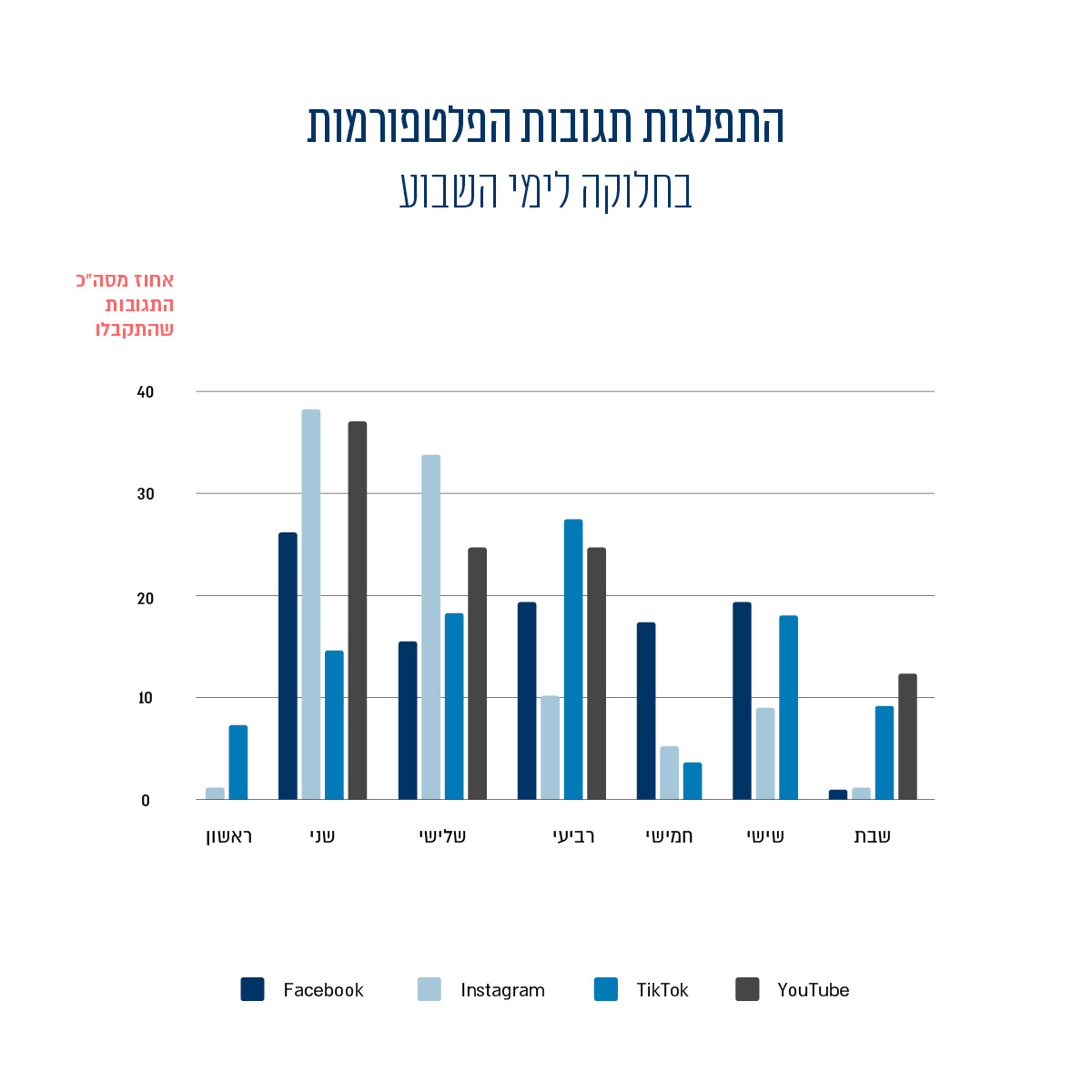

תגובת הפלטפורמות לפי ימי השבוע בשבועות הראשונים למלחמה

בניגוד להצהרות על היערכות החירום של הפלטפורמות בשל המלחמה והעליה בתוכן הדורש טיפול, היקף המענה מצד הפלטפורמות בסופי שבוע (שבת-ראשון) הוא כ-10% מההיקף הממוצע באמצע השבוע. היקף הדיווחים לפלטפורמות שהגיש קו הסיוע לאינטרנט בטוח אמנם ירד במהלך סופי השבוע בישראל (שישי-שבת), אך רק ב-60%, מה שלא מסביר את הירידה הדרמטית של 90% שהציגו הפלטפורמות.

התפלגות תגובות הפלטפורמות בחלוקה לימי השבוע

התפלגות תגובות הפלטפורמות בחלוקה לימי השבוע

ניתן לראות כי בניגוד לפלטפורמות האחרות, טיקטוק ויוטיוב מספקות מענה חלקי גם בסופי שבוע. לעומת זאת, בפייסבוק ואינסטגרם המענה בסופי שבוע הוא אפסי, וניכר כי צוותי המודרציה והבטיחות זמינים רק בימות העבודה המקובלים בצפון אמריקה ואירופה.

ג3. אפקטיביות המענה של הפלטפורמות לדיווחים

מאחר שכל דיווח נבחן לפני העברתו לפלטפורמות אל מול כללי המדיניות המוצהרים שלהן בידי הנציגים המיומנים של קו הסיוע, מקרים שבהם הפלטפורמה לא הסירה או סימנה את התוכן המדווח ללא הסבר או הצדקה מספקת מוגדרים כהיעדר פעולות אכיפה מספקות בטיפול בדיווח על תוכן פוגעני. במסגרת המחקר נערכה בחינה השוואתית של אחוז המקרים שבהם לא בוצעו פעולות אכיפה מספקות (מתוך כלל הדיווחים שהועברו לפלטפורמות לאורך החודשיים הראשונים של המלחמה) אל מול אחוז המקרים שזכו לטיפול ראוי. "טיפול ראוי" מוגדר כהסרה או סימון של התוכן המדווח, או לחלופין כהסבר משכנע לכך שהתוכן המדווח לא נחשב הפרת מדיניות. מקרים שבהם הועבר דיווח לפלטפורמה והיא לא טיפלה בו ללא מענה או הסבר מספק נחשבו לאירועים שבהם הפלטפורמה לא ביצעה פעולת אכיפה ראויה.

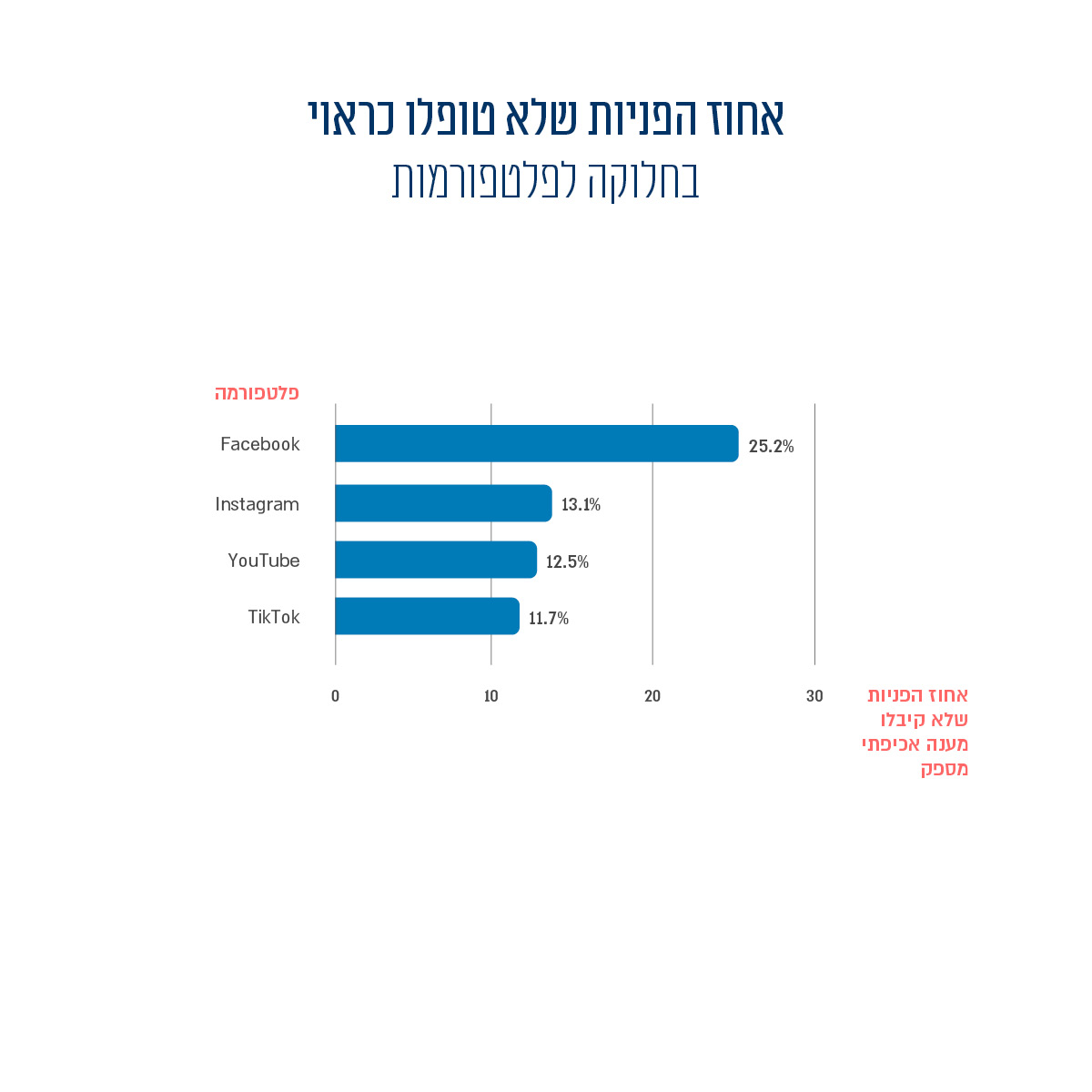

בתרשים הבא מוצג היקף הדיווחים שלא קיבלו מענה אכיפתי מספק, בחלוקה לפלטפורמות:

אחוז הפניות שלא טופלו כראוי, בחלוקה לפלטפורמות

אחוז הפניות שלא טופלו כראוי, בחלוקה לפלטפורמות

במבט השוואתי על אחוזי פעולות האכיפה הלא מספקות בטיפול בדווחים, פייסבוק בולטת לרעה עם 25% חוסר טיפול מספק (כלומר, 75% טיפול ראוי בלבד). לעומתה, הפלטפורמות האחרות לא נקטו פעולות אכיפה מספקות עבור 11-13 אחוז מהדיווחים (כלומר, 87-89 אחוז טיפול ראוי).

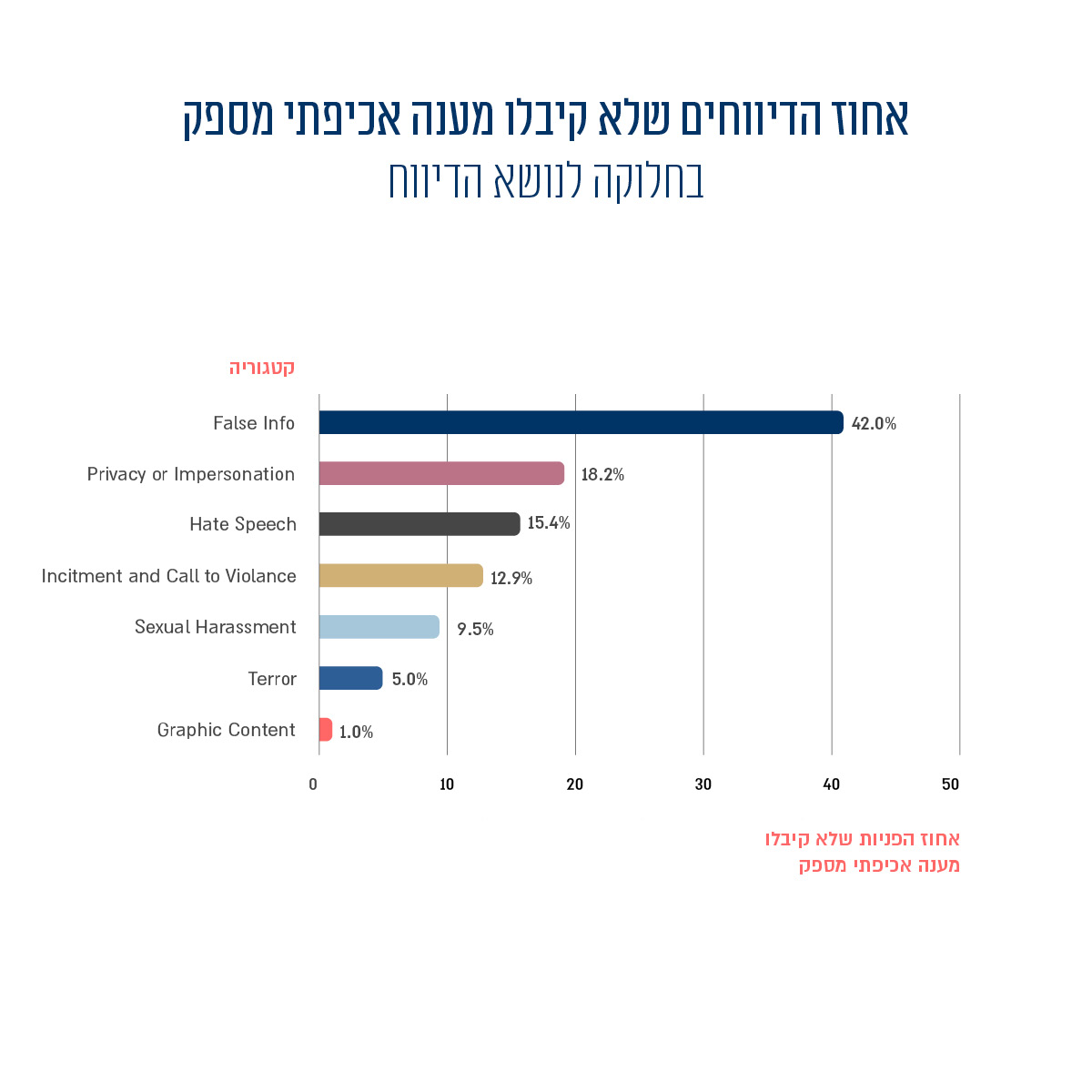

אחוז הדיווחים שלא קיבלו מענה אכיפתי מספק, בחלוקה לנושא הדיווח

אחוז הדיווחים שלא קיבלו מענה אכיפתי מספק, בחלוקה לנושא הדיווח

בהשוואה לפי סוגי תכנים פוגעניים, מתברר כי מידע כוזב (False Info) הוא סוג התוכן שבו אחוז הטיפול הלא מספק הוא הגבוה ביותר בממוצע, כאשר הפלטפורמות השונות לא נקטו פעולות אכיפה מספקות ב-42% מהדיווחים (ראו הרחבה בתת-הפרק הבא). אחוזי הטיפול הלא מספק גבוהים גם בדיווחים על פגיעה בפרטיות והתחזות, שיח שנאה והסתה וקריאה לאלימות (12-19 אחוז מהדיווחים). לעומת זאת, רוב רובם של הדיווחים על תוכן גרפי ותוכן תומך טרור זכו לטיפול ראוי (95-99 אחוז).

אפקטיביות וכשלים מצד הפלטפורמות: תכנים של שיח שטנה (Hate Speech)

שיח שטנה כולל הפצת פרסומים או התקפות ישירות נגד אנשים על בסיס מאפיינים מוגנים כגון גזע, דת, מין, העדפה מינית וכו,' באמצעות שפה תוקפנית, השמצות, שימוש בסטריאוטיפים פוגעניים, הצהרות על נחיתות מולדת וכיוצא בזה. שיח שטנה יוצר סביבת שיח של הפחדה וקיטוב ולעיתים אף מעודד אלימות פיזית ישירה. מרבית הרשתות החברתיות לא מאפשרות פרסום תכנים המוגדרים כשיח שטנה נגד קבוצות מיעוט בפלטפורמות שלהן(24) (25)

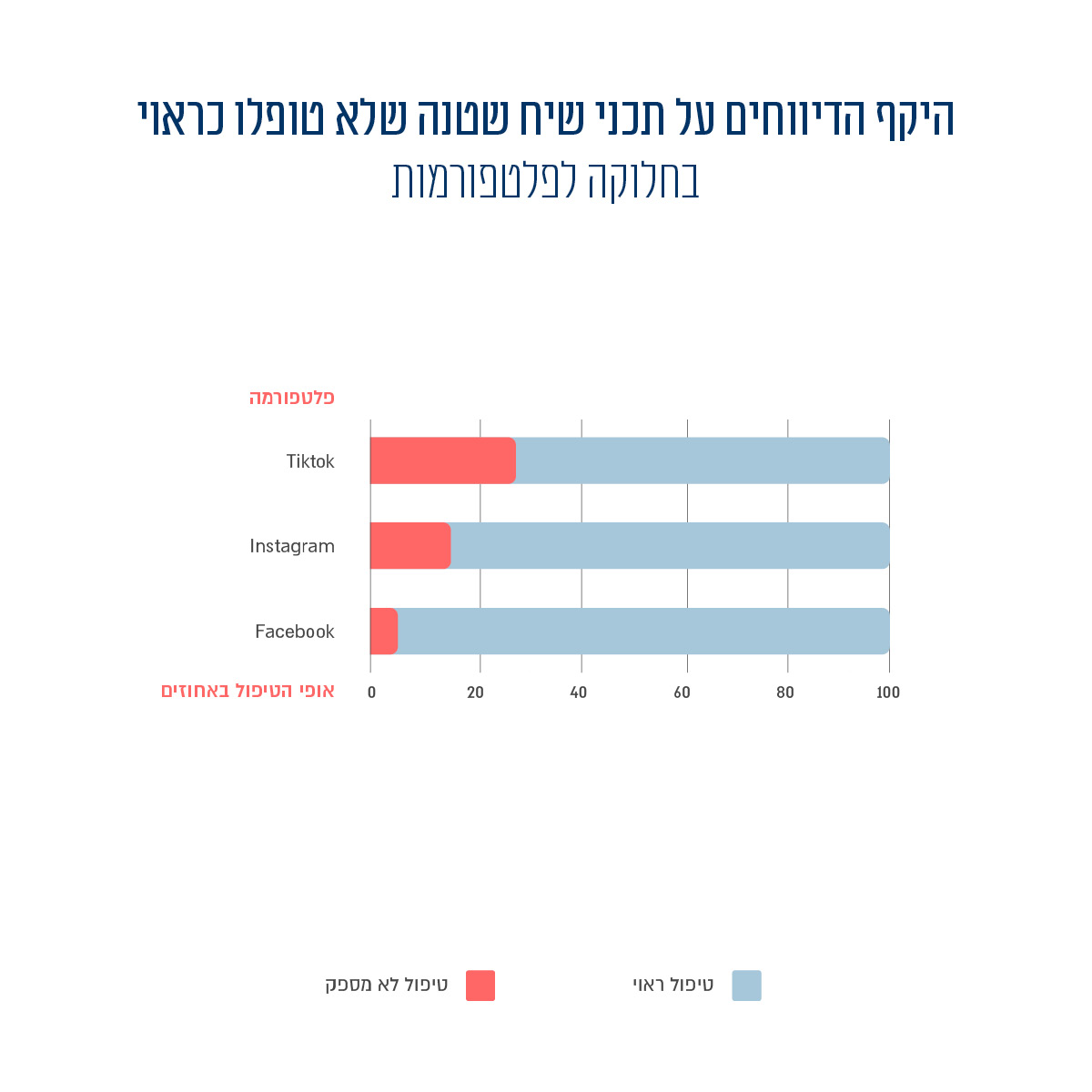

היקף הדיווחים על תכני שיח שטנה שלא טופלו כראוי, בחלוקה לפלטפורמות

היקף הדיווחים על תכני שיח שטנה שלא טופלו כראוי, בחלוקה לפלטפורמות

טיקטוק היא הפלטפורמה בעלת השיעור הנמוך ביותר של טיפול ראוי בדיווחים על שיח שטנה, כאשר עבור 26% מהדיווחים בנושא לא ננקטו פעולות אכיפה מספקות. אינסטגרם לא נקטה פעולות אכיפה מספקות בכ-15% מהדיווחים, ופייסבוק – בכ-5% בלבד.

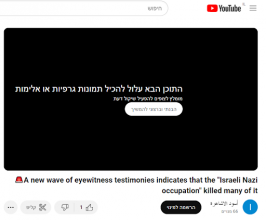

אפקטיביות וכשלים מצד הפלטפורמות: תוכן גרפי (Graphic Content)

תוכן גרפי הוא תמונות או קטעי וידאו מזעזעים, המכילים תוכן אלים או בוטה במיוחד, כגון פציעות חמורות, גופות, הפעלת אלימות וגרימת סבל חמור, או לחלופין תכנים מיניים בוטים או קשים שאינם מתאימים לצפייה של הקהל הרחב. מאז פרוץ המלחמה הוצפו פלטפורמות המדיה החברתית בתכני זוועה מסוג זה, שתיעדו את אירועי הטבח והחטיפות ב7- באוקטובר ביישובים ישראליים ואת הפצצות צה"ל ברצועת עזה.

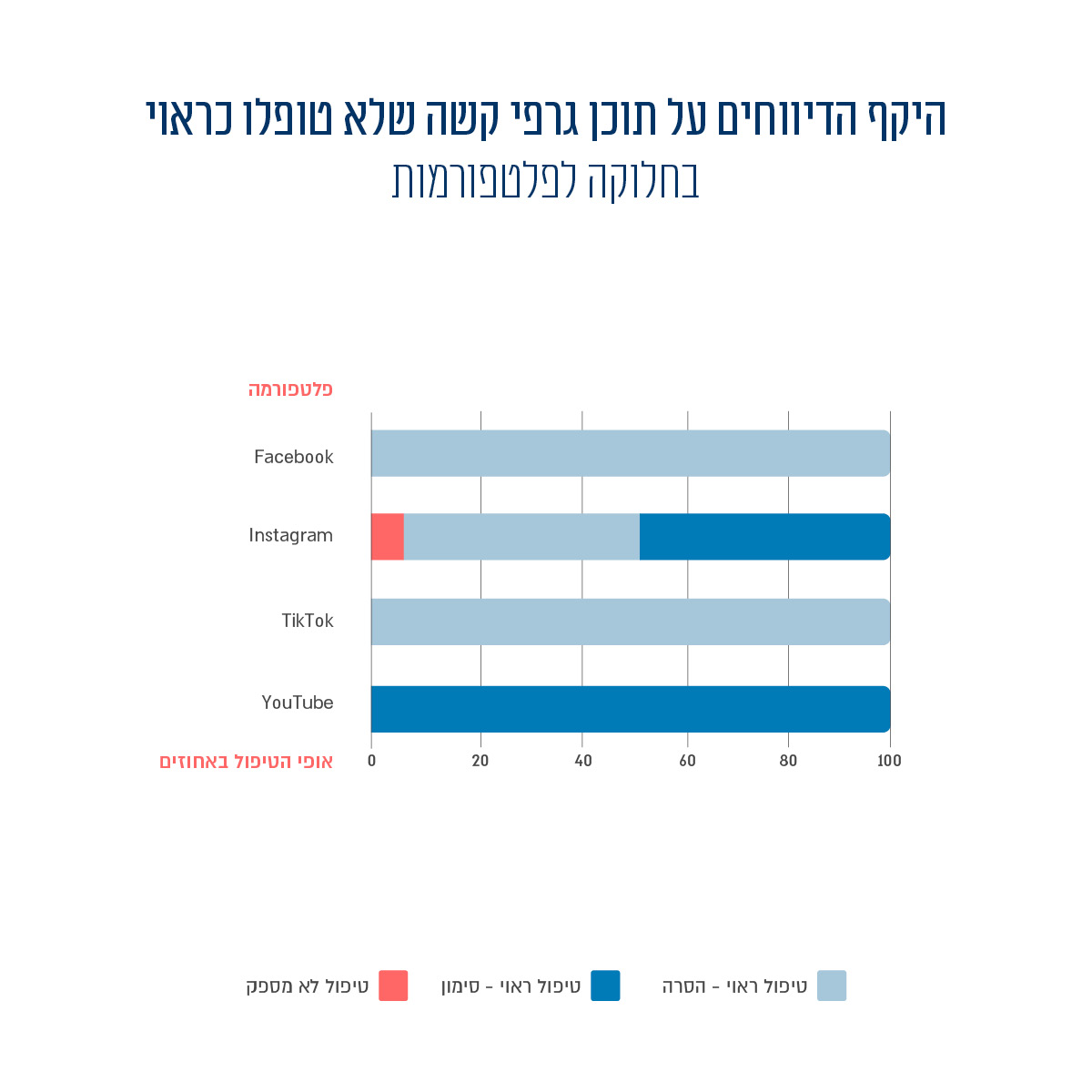

בחינה של אופן הטיפול בתוכן גרפי מראה כי אינסטגרם נוקטת במדיניות משתנה לגבי פרסומים מסוג זה, בשונה מפלטפורמות אחרות. לעיתים היא מסירה את התוכן, ובמקרים שהתוכן אינו מוסר, לרוב מתווספים אליו סימון ותווית אזהרת צפייה, אשר מתריעה מפני התוכן הגרפי המוצג בפוסט. 94% מהדיווחים שהעביר קו הסיוע לאינסטגרם בנוגע לתוכן גרפי טופלו כראוי. מבין אלה, נמצא כי מחצית הוסרו מהפלטפורמה, ולמחצית השנייה נוספו סימון ותווית אזהרת צפייה. יש לציין כי בשאר הפלטפורמות מדגם הדיווחים על פרסומים המכילים תוכן גרפי היה קטן.

היקף הדיווחים על תוכן גרפי קשה שלא טופלו כראוי, בחלוקה לפלטפורמות

היקף הדיווחים על תוכן גרפי קשה שלא טופלו כראוי, בחלוקה לפלטפורמות

ג4. מאפיינים וכשלים ייחודים בטיפול הפלטפורמות במידע כוזב ודיסאינפורמציה

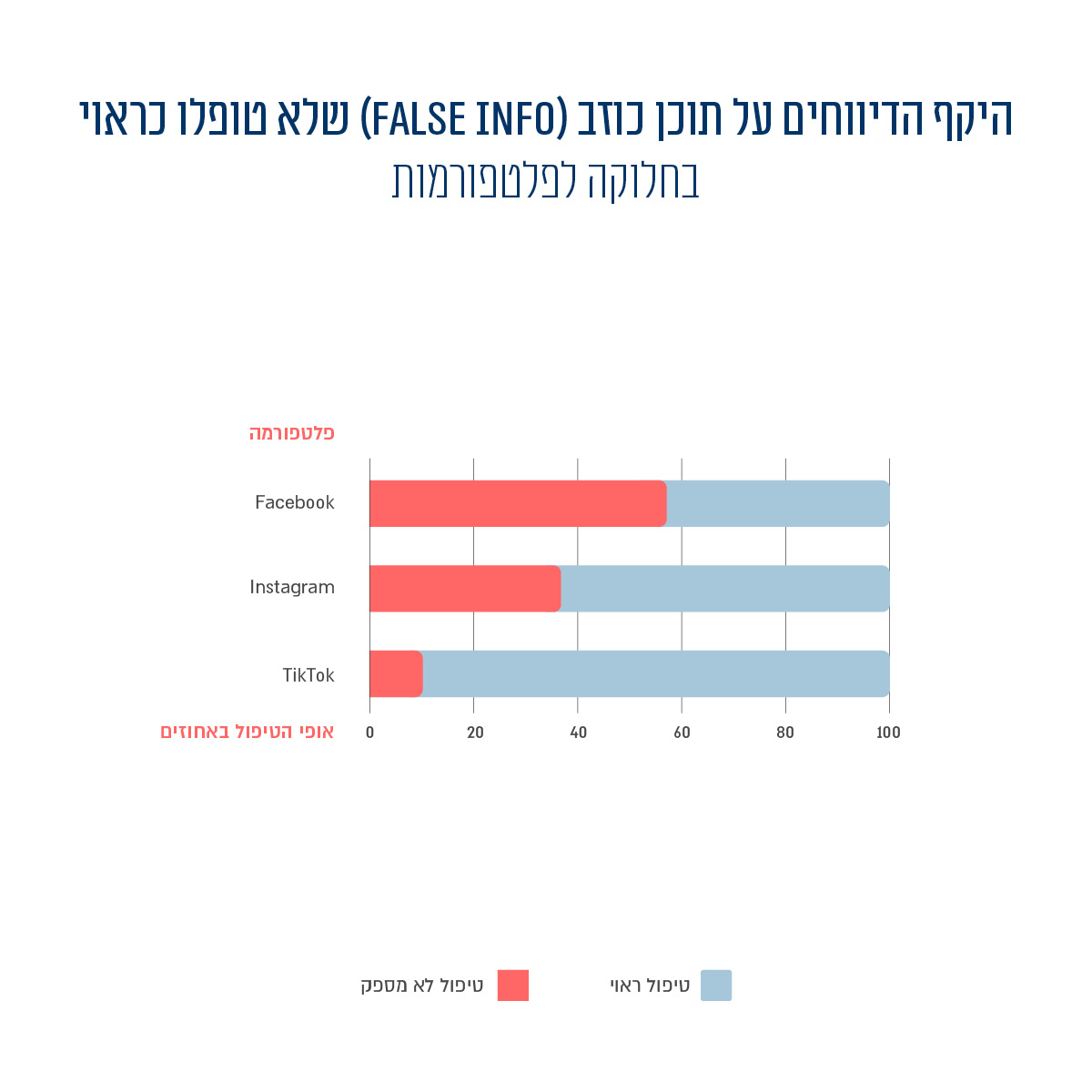

בטיפול בדיווחים על תוכן כוזב, פייסבוק בולטת לרעה – הפלטפורמה לא נקטה פעולות אכיפה מספקות ב-57% מהדיווחים שקיבלה מקו הסיוע לגבי תוכן שקרי ומידע מטעה.

היקף הדיווחים על תוכן כוזב Info( )False שלא טופלו כראוי, בחלוקה לפלטפורמות

היקף הדיווחים על תוכן כוזב Info( )False שלא טופלו כראוי, בחלוקה לפלטפורמות

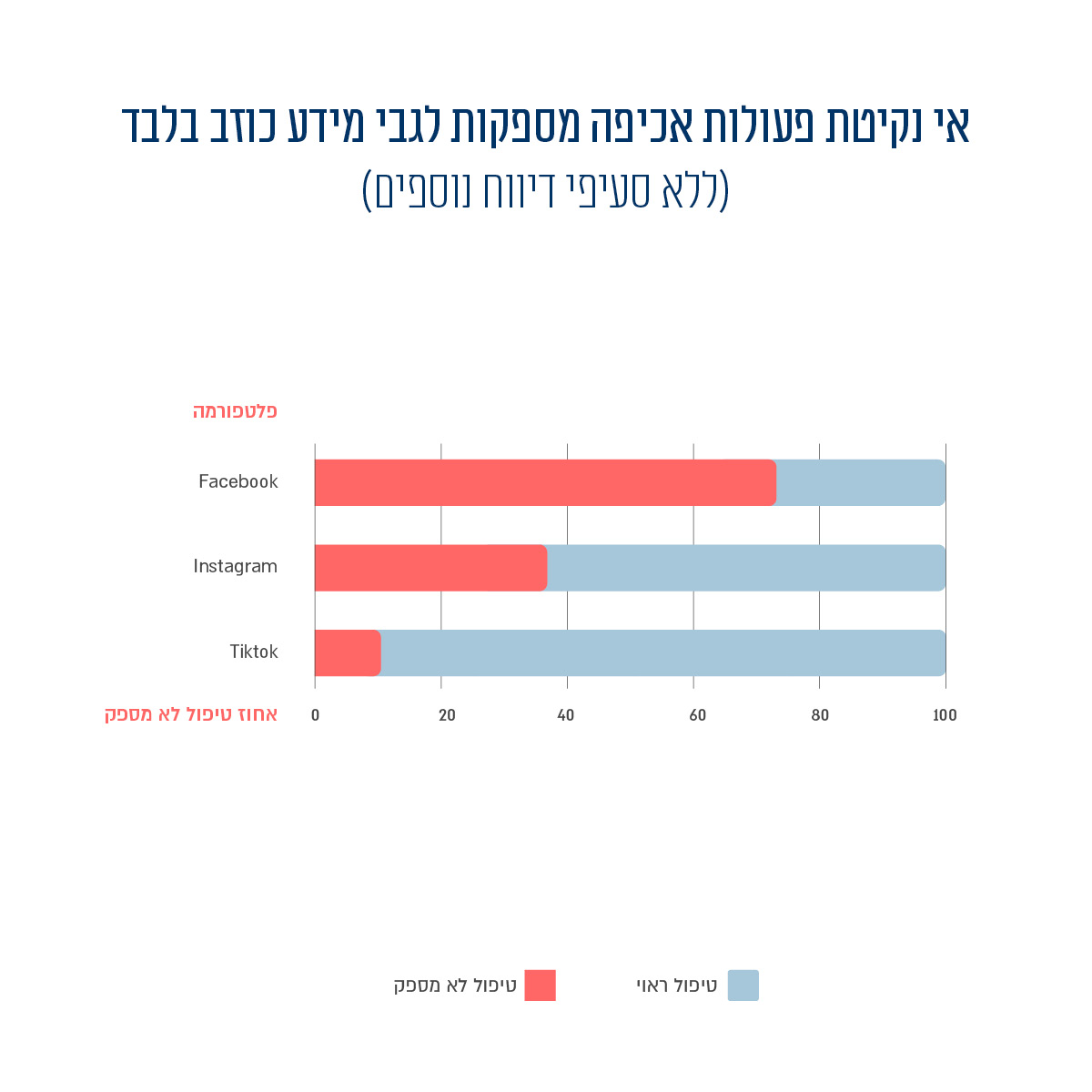

בחינה מעמיקה של תגובת הפלטפורמות לדיווחים על תוכן שסומן כשקרי וכוזב (False Info) בלבד – בניכוי דיווחים על כמה נושאים במקביל, למשל מידע מטעה שהוא גם הסתה לאלימות – הראתה כי פייסבוק לא נקטה פעולות אכיפה מספקות ב-72% מהמקרים. לעומת זאת, עבור אינסטגרם וטיקטוק לא נמצא הבדל מהותי. נתון זה מחזק את הרושם כי ביחס לפלטפורמות האחרות, פייסבוק מתקשה לטפל או נמנעת מטיפול שיטתי בדיווחים על תכנים המוגדרים דיסאינפורמציה או תוכן כוזב.

אי נקיטת פעולות אכיפה מספקות לגבי מידע כוזב בלבד (ללא סעיפי דיווח נוספים)

אי נקיטת פעולות אכיפה מספקות לגבי מידע כוזב בלבד (ללא סעיפי דיווח נוספים)

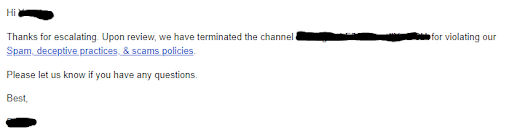

ג5. איכות המענה והמידע שהפלטפורמות מספקות לדיווחי Trusted Flaggers

הבדיקות ההשוואתיות התייחסו גם לאופי ולתוכן של התגובה המילולית מצד הפלטפורמות לדיווחי קו הסיוע של איגוד האינטרנט הישראלי, שבו הן מכירות כמדווח אמין או שותף דיווח ייחודי בשנים האחרונות. תגובת הפלטפורמות לדיווח היא הדרך היחידה של קו הסיוע להתעדכן בנוגע לגורל הדיווחים שהעביר, וכך לנהל את הפניות המתקבלות, לסגור פניות שטופלו, וגם ללמוד ולהשתפר בסינון הפניות מהציבור והעברת דיווחים מדויקים לפי סעיפי המדיניות הרלוונטיים. ככלל, התגובות מגיעות לכתובת המייל הייעודית של קו הסיוע, שדרכה מתבצעים הדיווחים לפלטפורמות. מלבד מהות התגובה (התקבל/נדחה) והפעולה שננקטה (הוסר/סומן וכו'), נבדקו גם התוכן והנוסח של תגובות הפלטפורמות, על מנת לבחון את יחסן לדיווחים שהן מקבלות מגופי דיווח רשמיים המוגדרים Trusted Flagger.

בהכללה, בבחינה ההשוואתית נמצא כי מטא (בעלת פייסבוק ואינסטגרם) מספקת תשובות קבועות, שבלוניות ושטחיות בתגובה לדיווחים, שאינן כוללות מידע או מתייחסות לתוכן הדיווח הספציפי.

מענה חברת מטא לדיווחי קו הסיוע על תוכן פוגעני

נוסח תגובת מטא לדיווחי קו הסיוע במקרים שבהם התוכן המדווח הוסר או סומן:

"Thank you for your report. Please note that we have now reviewed the related content and taken appropriate action. Do not hesitate to let us know if you require further assistance."

נוסח תגובת מטא לדיווחי קו הסיוע במקרים שבהם התוכן המדווח הועבר לבודקי עובדות עצמאיים:

“We have reviewed your report. It unfortunately isn't clear to us that any of the reported content violates Facebook’s Community Standards or Instagram’s Community Guidelines.We have passed the content to third party fact checkers (3PFC) for review for potential misinformation.”

נוסח תגובת מטא אשר מצביע לרוב על כך שהתוכן הוסר עוד לפני שהצוותים השפיקו לתת מענה לדיווח:

“It looks like the content you reported is no longer accessible on our site. If you’re still seeing this content on the site, please reply to this email with a web address (URL) that links directly to the potentially violating material, in order for our teams to review it.”

נוסח תגובת מטא אשר מצביע לרוב על החלטה שלא לנקוט צעדים בנוגע לתוכן המדווח:

“Our team has done an in depth investigation of the content in question, but has found that it does not violate our Community Standards”

בהקשר של דיווחים על מידע שגוי או הטעיה, לעיתים מתקבלת תגובה כללית על העברת המקרה לבודקי עובדות עצמאיים. בדומה לכך, גם טיקטוק מתאפיינת בתגובות שבלוניות ולקוניות לדיווחים של קו הסיוע המוכרים על ידה כמהימנים.

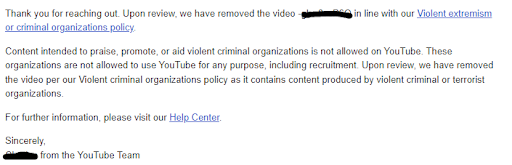

לעומתן, יוטיוב מספקת תשובה מפורטת וייעודית לכל דיווח ומדגישה את סעיף המדיניות שהופר ועל בסיסו ננקטה הפעולה. התגובות של צוותי הבטיחות של יוטיוב בולטות בהיותן מפורטות ואישיות, ומתייחסות לתוכן המדווח ולסעיפי המדיניות הרלוונטיים. הן כוללות פנייה אישית למדווח (נציג קו הסיוע) בשמו, ועל המייל חתום בשמו אחד מעובדי הפלטפורמה. תגובות כאלה עוזרות לצוות קו הסיוע להשתפר, לאפיין, להבין ולדייק דיווחים עתידיים.

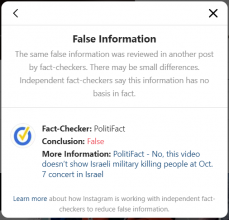

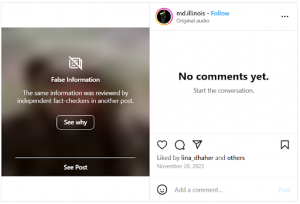

ג6. סימון וחיווי למשתמשים על פעולות אכיפת התוכן שמבצעות הפלטפורמות

הפלטפורמות נוקטות צעדים מגוונים כלפי תוכן גרפי אשר מפר את מדיניותן ועלול לסכן משתמשים או לפגוע בהם, אך הוחלט שלא להסירו. אחד הצעדים הללו הוא סימון התוכן באמצעות טשטושו והוספת הערת אזהרה או הערת הקשר לפני הצפייה, שמהווה תחליף להסרה מוחלטת ומאפשרת למשתמשים לקבל החלטה מושכלת לגבי צריכתו.

- דוגמאות לסימון תוכן גרפי שלא הוסר (בתגובה ל-22 דיווחים באינסטגרם ו-2 ביוטיוב)

- דוגמאות לסימון תוכן גרפי שלא הוסר (בתגובה ל-22 דיווחים באינסטגרם ו-2 ביוטיוב)

- סימון של מידע כוזב בידי בודקי עובדות חיצוניים (בתגובה לדיווח אחד בלבד באינסטגרם)

- סימון של מידע כוזב בידי בודקי עובדות חיצוניים (בתגובה לדיווח אחד בלבד באינסטגרם)

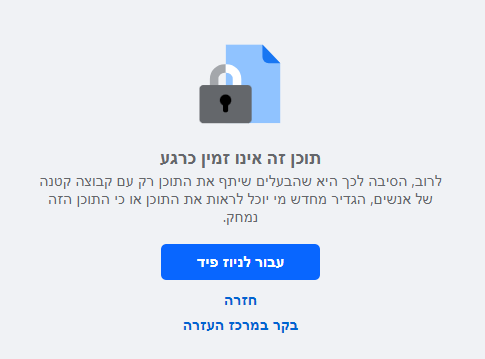

בשונה מההערות והתוויות המתווספות לתוכן מסומן, כאשר התוכן מוסר מהפלטפורמה מוצגת הודעה למשתמש כי הוא הגיע לתוכן שאינו זמין. אולם, רוב הפלטפורמות אינן מסבירות או מציגות מה היה התוכן שהוסר, מדוע הוסר, על סמך איזה סעיף מדיניות, והאם הסרתו הייתה פעולת אכיפה או פעולה שביצע המשתמש שהעלה אותו, כמו הגבלת פרטיות והרשאות הצפייה או מחיקת הפוסט.

חוסר השקיפות והפירוט הדל אינם מאפשרים למשתמשים לדעת מה עלה בגורל התוכן ומדוע, ומונעים גביית מחיר ציבורית מחשבונות שננקטו כלפיהם פעולות אכיפה, או סימון משתמשים שהתחרטו על הפרסום והסירו אותו בעצמם, והעלאת מודעות אצל עוקבים ומשתמשים אחרים בנוגע לפרסומים פסולים שנמחקו.

חוסר הפירוט והשקיפות גם מונע מגופי הדיווח המוכרים (Trusted Flagger) לבחון את פעולות האכיפה שביצעו הפלטפורמות ואת הטיפול בדיווחים שהעבירו להן. הדבר פוגע בתהליכי העבודה של גופים אלה, בעיקר לנוכח הדלות, השבלוניות והגנריות של התגובה לדיווחים במייל.

בהכללה, הבחינה ההשוואתית מצאה כי טיקטוק והפלטפורמות של מטא מציגות מידע מעורפל על גורלו של התוכן. לא ניתן לדעת אם התוכן הוסר בשל פעולת אכיפה, מאיזה סוג ועל סמך איזה סעיף, או אם בכלל מדובר בפעולה של המשתמש עצמו. טיקטוק אף מגדילה לעשות ומעודדת את המשתמשים להמשיך ולצרוך תוכן נוסף בפלטפורמה. לעומתן, יוטיוב מפרטת מעט יותר ומציינת כי ננקטה פעולת אכיפה כנגד התוכן או החשבון, אך אינה מפרטת מה הן העבירות ועל סמך אילו סעיפי מדיניות נקבע שנעשתה עבירה.

דוגמאות לאופן הצגת תוכן שהוסר מהפלטפורמה

(לרוב, הסיבה לכך היא שהבעלים שיתף את התוכן עם קבוצה קטנה של אנשים, הגדיר מחדש מי יכול לראות את התוכן או כי התוכן הזה נמחק)

מחפש סרטונים? נסה לדפדף ביוצרים, בהאשטגים ובסאונדים הטרנדיים שלנו)

הערות שוליים

- Countering hate on TikTok | TikTok. https://www.tiktok.com/safety/en/countering-hate/

- Hate speech | Meta Transparency Center. https://transparency.meta.com/policies/community-standards/hate-speech/

- Meta's Third-Party Fact-Checking Program https://www.facebook.com/formedia/mjp/programs/third-party-fact-checking